AMD onthult zijn platonisch ideaal: een open en schaalbaar AI-ecosysteem, gesteund op eigen GPU’s, software en infrastructuur. Partners zoals Meta, OpenAI en Oracle doen alvast mee.

Tijdens het Advancing AI 2025-evenement heeft AMD zijn visie gepresenteerd voor een volledig geïntegreerd AI-platform. Centraal daarin staat AMD’s eigen technologie: van de nieuwe Instinct MI350 GPU’s, een open rack-infrastructuur tot een update van de ROCm-softwarestack. AMD reikt de grote AI-spelers de hand om die droom mee te verwezenlijken.

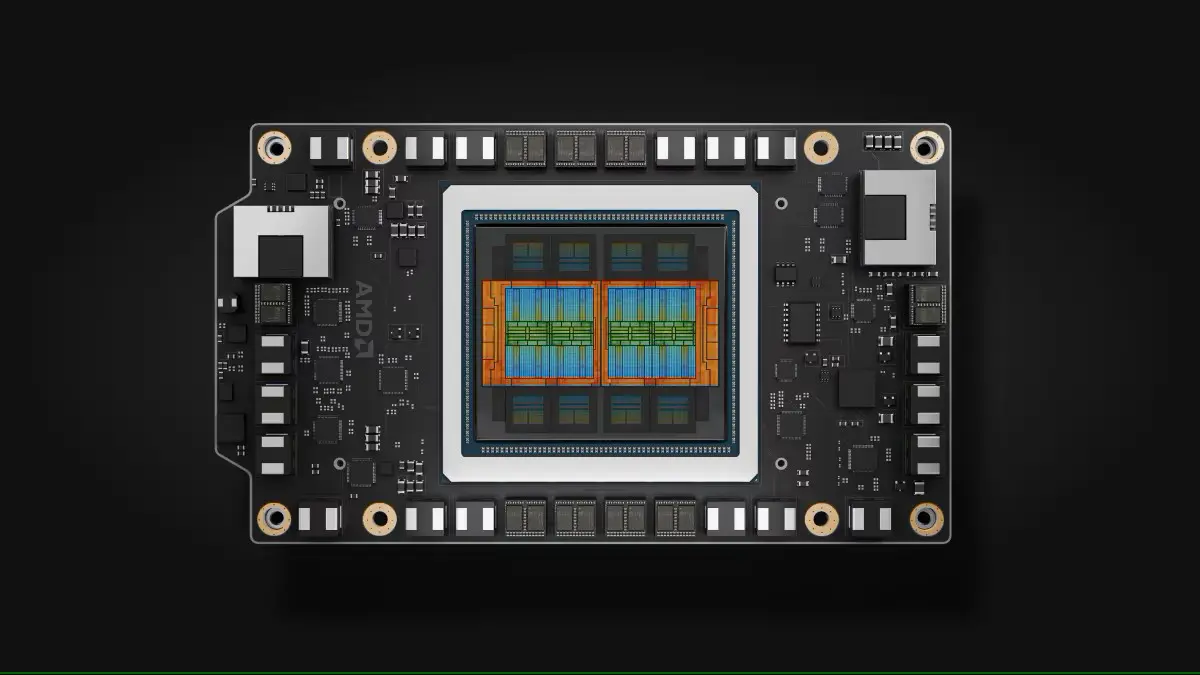

De chipfabrikant stelt de nieuwste accelerators uit de MI350-reeks voor, die vroeger dan aanzienlijk gepland lanceren. Volgens AMD leveren de MI350X- en MI355X-chips een viervoudige prestatiewinst ten opzichte van de vorige generatie. De MI355X biedt daarnaast tot 40 procent meer tokens-per-dollar in vergelijking met alternatieve oplossingen.

Chips, racks en software

De Instinct MI350 wordt ingezet in hyperscale AI-infrastructuur samen met de vijfde generatie Epyc-processoren en Pensando Pollara-netwerkkaarten. Oracle Cloud Infrastructure is een van de eerste die deze technologie grootschalig uitrolt.

AMD gaf ook een eerste blik op het Helios-rack, dat in de toekomst zal draaien op de MI400 GPU’s en nieuwe Zen 6 EPYC-processoren. Deze zouden tot tien keer snellere inferentieprestaties leveren bij modellen gebaseerd op Mixture of Experts.

Tot slot stelde AMD zijn Developer Cloud open voor het bredere ontwikkelaars- en open source-ecosysteem. Dit platform biedt toegang tot een beheerde omgeving voor AI-projecten met ondersteuning van ROCm 7. Daarmee wil AMD de drempel verlagen voor AI-ontwikkeling en samenwerking stimuleren binnen een open ecosysteem.

Uitgestoken hand

AMD benadrukte zijn open aanpak door samenwerkingen aan te gaan met diverse spelers in het AI-landschap en menig grootheid uit de AI-wereld aanvaardt die uitgestoken hand. Meta gebruikt de Instinct-GPU’s voor de inferentie van zijn LLama-modellen. OpenAI draait GPT-modellen op Azure met AMD-hardware en werkt mee aan de ontwikkeling van de MI400-platforms. Microsoft zet de MI300X in voor eigen en open modellen op Azure.

Andere partners zijn onder meer Cohere, dat zijn Command-modellen inzet op AMD-hardware, en Red Hat, dat de MI GPU’s gebruikt in OpenShift AI. Daarnaast zet Humain in op een brede samenwerking met AMD voor schaalbare AI-infrastructuur. Astera Labs en Marvell bouwen mee aan UALink, een open standaard voor AI-interconnectiviteit.

Alomtegenwoordige concurrent

Met een open ecosysteem wil AMD zich verder opwerpen als uitdager van Nvidia. AMD lijkt zowat de enige die daartoe in staat is, al is Nvidia een flinke horde waar het over moet. De laatste weken is nog maar eens duidelijk geworden hoe alomtegenwoordig Nvidia is in AI-datacenters. Jensen Huang kondigde tijdens zijn Europese tournee de ene na de andere samenwerking aan. Iedere partij die met lof zwaait voor AMD, staat minstens even graag op de foto met Huang.

In één domein blijft AMD onklopbaar: supercomputers. In de nieuw gepubliceerde Top 500-lijst prijkt AMD met zowel El Capitan als Frontier fier bovenaan. Nvidia is echter nooit veraf en klimt met de Europese Jupiter-computer snel naar de top.