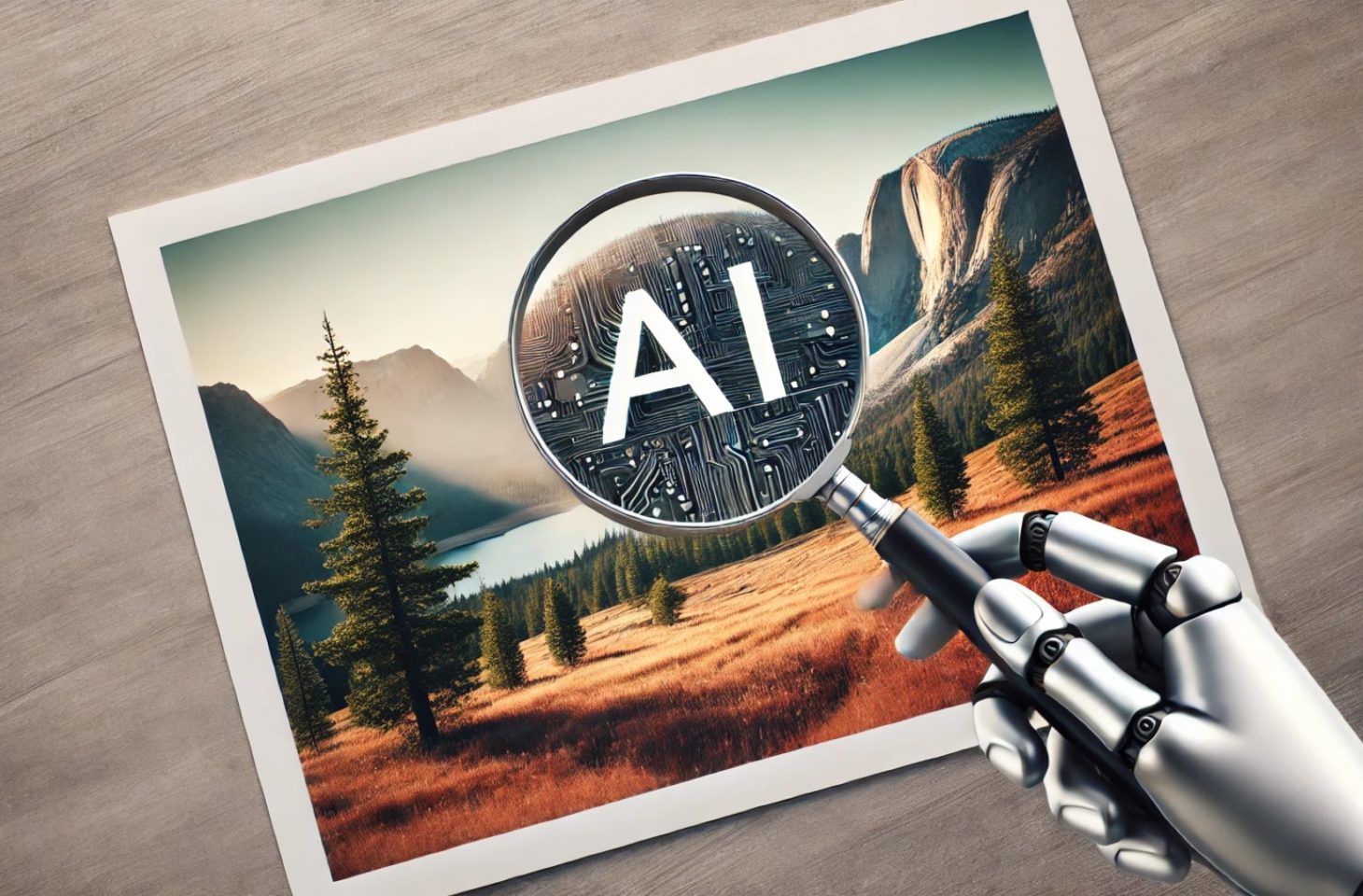

Cloudflare heeft een nieuwe functie toegevoegd om eenvoudig AI-gemanipuleerde afbeeldingen te detecteren.

Hostingprovider Cloudflare integreert Adobe’s Content Credentials-systeem, waarmee gebruikers de authenticiteit van afbeeldingen eenvoudig kunnen achterhalen. Adobe’s tool past een digitale metadatatag toe op iedere afbeelding, om zo de eigenaar snel te achterhalen, maar ook waar ze zijn geplaatst en of ze gemanipuleerd zijn.

Digitale herkomst

Cloudflare introduceert een nieuwe functie binnen zijn netwerk waarmee gebruikers de authenticiteit van afbeeldingen kunnen vastleggen en controleren. Contentmakers en uitgevers kunnen via een eenvoudige klik de digitale geschiedenis van een afbeelding bewaren. Dit omvat informatie over de oorspronkelijke maker, bewerkingen en formaatwijzigingen. De functie is gebaseerd op de standaarden van de Coalition for Content Provenance and Authenticity (C2PA).

Het doel is om makers te erkennen en consumenten inzicht te geven in de herkomst en aanpassingen van digitale beelden. Cloudflare sluit zich hiermee aan bij het Content Authenticity Initiative (CAI), een door Adobe geleide community die pleit voor brede ondersteuning van Content Credentials als standaard.

Betrouwbaarheid versterken

De mogelijkheid om afbeeldingen wereldwijd snel te delen brengt uitdagingen met zich mee, vooral door de opkomst van generatieve AI. Het wordt steeds moeilijker om echte en gemanipuleerde beelden van elkaar te onderscheiden. Cloudflare stelt dat deze nieuwe functie media- en nieuwsorganisaties helpt bij het verifiëren van beeldmateriaal en het behouden van eigenaarschap.

lees ook

Google helpt je binnenkort AI-afbeeldingen op te sporen

Gebruikers van Cloudflare Images, de opslag- en optimalisatiedienst van het bedrijf, kunnen nu de optie ‘Preserve Content Credentials’ inschakelen. Dit beschermt de ingesloten metadata en slaat alle bewerkingen versleuteld op. De digitale geschiedenis van een afbeelding kan vervolgens worden geverifieerd via Adobe Content Authenticity Inspect.