HPE lanceert een rack-scale AI-architectuur rond AMD’s nieuwe Helios-ontwerp, uitgerust met een bliksemsnelle Broadcom Tomahawk 6 netwerkchip. De oplossing richt zich op cloudproviders die AI-training en inference op grote schaal willen uitrollen.

HPE brengt een nieuwe rack-scale AI-architectuur op de markt die AMD’s Helios-platform combineert met een door HPE Juniper Networking ontwikkelde ethernet-gebaseerde switch. De oplossing biedt cloud service providers een volledig geïntegreerd rack dat is ontworpen voor workloads zoals training van modellen met biljoenen parameters en grootschalige inferentie.

Rack-scale AI gericht op groeiende vraag naar compute

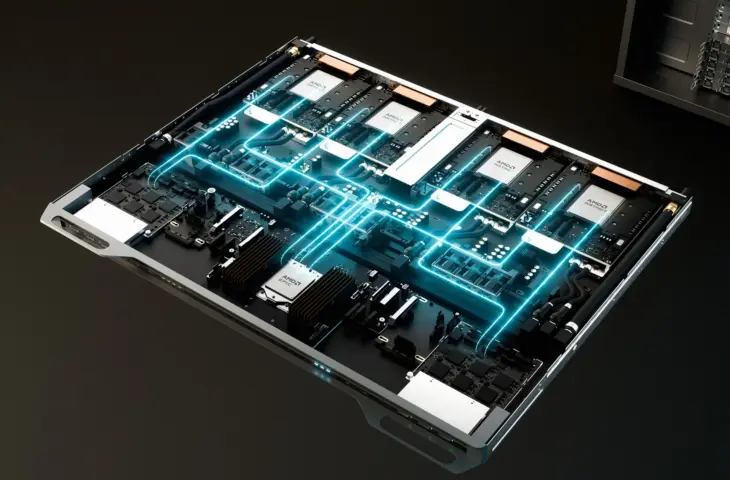

Net voor HPE Discover Barcelona 2025 kondigt het merk een rack met 260 TB/s aan scale-up bandbreedte en 2,9 exaflops FP4-rekenkracht dankzij 72 gekoppelde AMD Instinct MI455X-GPU’s. Daarmee richt HPE zich op organisaties die AI-clusters verder willen opschalen, maar flexibiliteit en open standaarden willen behouden. Configuraties zijn mogelijk tot 31 TB HBM4-geheugen en 1,4 PB/s geheugenbandbreedte.

De rack-architectuur volgt de Open Rack Wide-specificaties van het Open Compute Project (OCP). Deze standaard introduceert een dubbelbrede rackopbouw met vloeistofkoeling en een layout die onderhoud moet vereenvoudigen. De nadruk op open standaarden sluit aan bij HPE’s eerder getoonde strategie om vendor lock-in te vermijden.

Ethernet als scale-up netwerk voor AI-training

Een opvallend element van de oplossing is het gebruik van ethernet voor scale-up netwerkverkeer binnen het rack. Het nieuwe switchplatform, ontwikkeld met Broadcom’s Tomahawk-6-silicon, maakt gebruik van Ultra Accelerator Link over Ethernet (UALoE) .

Door ethernet in te zetten als verbindingslaag wil HPE een alternatief aanbieden voor propriëtaire interconnecttechnologieën. Dit past binnen de bredere AI-netwerkstrategie van HPE, waarin scale-up, scale-out en scale-across netwerklagen elkaar aanvullen binnen AI-datacenters.

Het nieuwe switchplatform sluit aan op bestaande HPE-netwerkcomponenten zoals de QFX5250 scale-out switch en PTX-routers, als bouwstenen voor AI-clusterverbindingen binnen en tussen datacenters.

lees ook

HPE breidt zijn Cray-supercomputers uit met nieuwe onderdelen

Integratie van vloeistofkoeling en HPE-diensten

Het systeem wordt geleverd met ondersteuning van HPE’s serviceteams, die ervaring hebben met vloeistofgekoelde infrastructuur en exascale-installaties. HPE benadrukt meermaals dat vloeistofkoeling essentieel is voor nieuwe AI-generaties, onder meer bij de QFX5250-switch en het Helios-rack zelf. De geïntegreerde koeling moet het energieverbruik beperken en dicht bepakte GPU-clusters stabiel laten draaien.

Het rack ondersteunt ook AMD’s ROCm-software en Pensando-technologie voor netwerkversnelling en security. Met deze combinatie wil HPE bedrijven een open architectuur bieden die geschikt is voor snelle iteratie van AI-modellen en grootschalige uitrolscenario’s.

Het AMD Helios AI Rack wordt wereldwijd beschikbaar in 2026.