In 2018 introduceerde Google beleidsregels rond AI. De kern daarvan was een belofte om zeker geen AI te ontwikkelen die schade kon berokkenen. Die belofte is nu van de website verdwenen.

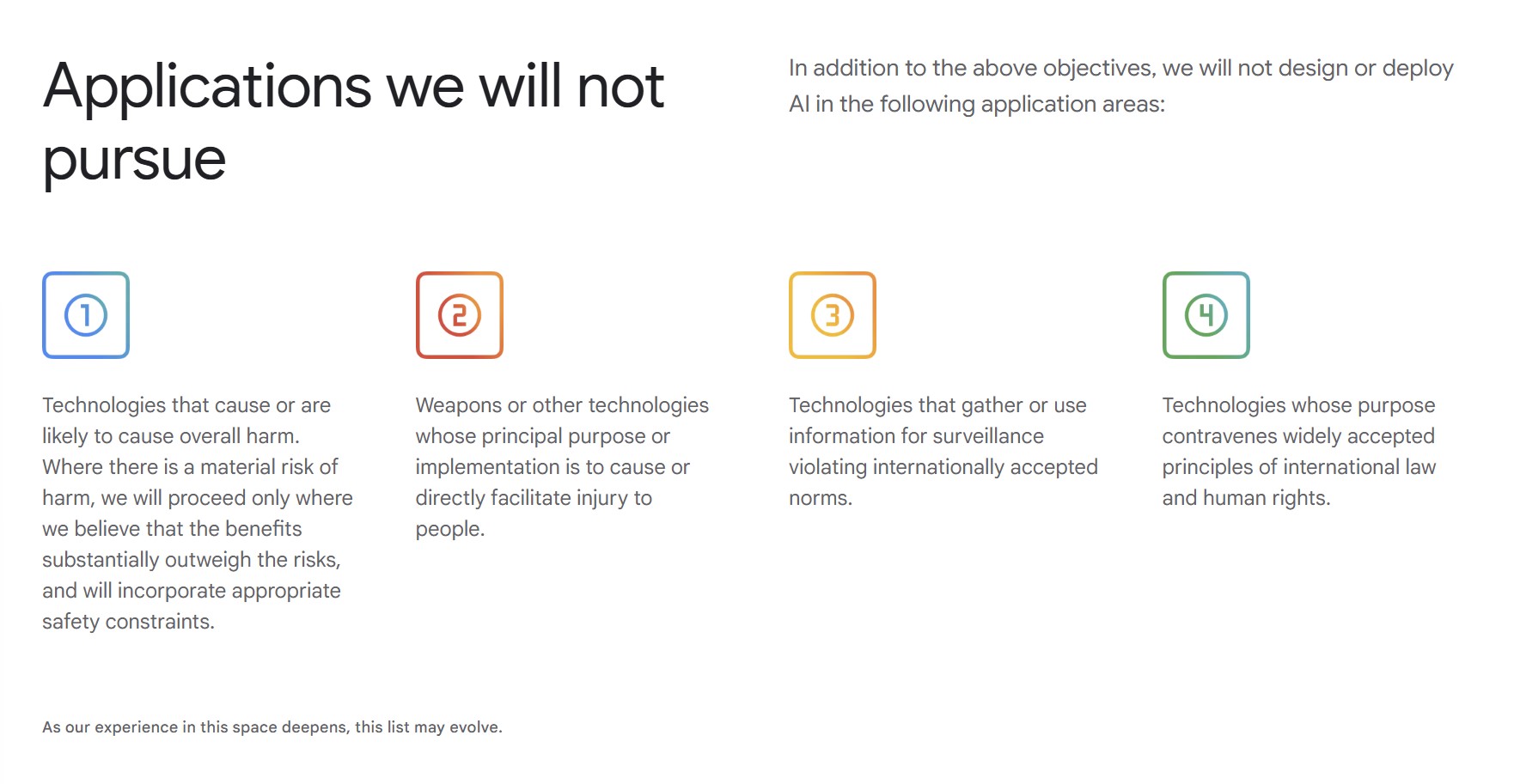

Beloftes maken is eenvoudig, ze nakomen iets minder. In 2018 publiceerde Google duidelijke richtlijnen rond zijn AI-ontwikkeling. Daarbij gaf het bedrijf aan dat alle innovatie zou stoelen op pijlers zoals ingebouwde privacy, verantwoordelijkheid, veiligheid en sociale meerwaarde. Google schreef tevens zwart-op-wit welke toepassingen het niet zou onderzoeken:

- Technologieën die schade kunnen berokkenen

- Wapens of andere technologie waar het doel van is om mensen te verwonen

- Technologie voor surveillance die internationale normen overschrijdt

- Toepassingen die indruisen tegen de principes van de mensenrechten en internationale wetgeving

“Naarmate we meer ervaring opdoen in dit domein, kan deze lijst evolueren”, gaf Google nog mee. Dat was niet gelogen. De hele rubriek met onderzoek dat Google niet zou voeren, is verdwenen. In de nieuwe richtlijnen kan AI wel ontwikkeld worden voor alle bovenstaande doeleinden. De originele pagina is nog wel gearchiveerd te bekijken. De Washington Post ontdekte als eerste dat Google de richtlijnen had geschrapt.

Geen echte principes

De zet toont aan hoe waardeloos zelf opgelegde bedrijfsprincipes zijn. De belofte van Google om iets niet te doen, bleef overeind tot Google besliste om het wel te doen. De lijst van toepassingen die off-limits was, bleek zo eerder een lijst van onderzoek waar Google simpelweg nog aan moest beginnen.

lees ook

Microsoft en Google rammen AI door je strot (en laten je ervoor betalen)

Het is tekenend dat Google niet meer durft zeggen dat het geen AI voor wapens wil ontwikkelen. Het bedrijf blijft wel vermelden dat het zijn oplossingen wil bouwen in lijn van de breed geaccepteerde principes van internationaal recht en de mensenrechten. Aangezien dezer dagen slechts weinig van die principes internationaal breed geaccepteerd of gevolgd worden, en Google zelf hoofdkwartier heeft in een land waar de president net tot etnische zuiveringen heeft opgeroepen, opent dat de deuren voor heel wat minder menslievende toepassingen.

Morele flexibiliteit in naam van nationale veiligheid

In een blogpost stelt Google vast dat de technologie snel evolueert, en dat het nodig is voor landen in democratische landen om AI te ontwikkelen die de nationale veiligheid ondersteunt. Wat Google zegt, is in ieder geval niet heel relevant, aangezien het te allen tijde offline gehaald kan worden als een andere visie interessanter lijkt. Er is niets mis met voortschrijdend inzicht, maar flexibele principes zijn doorgaans geen mooie eigenschap.

Google is niet alleen. OpenAI is al in zee gegaan met het Pentagon en Anthropic werkt zelfs samen met Palantir, dat met zijn technologie ICE-raids ondersteund en meewerkte aan het beleid waarbij kinderen van hun ouders werden gescheiden en in kooien werden gevangengezet.

Zo werken alle grote AI-bedrijven op dit moment samen met organisaties die aan surveillance doen en wapens bouwen. In Europa bestaat er wetgeving die AI voor dergelijke verregaande praktijken verbiedt, maar de VS hebben dergelijke beschermingen niet.